摘要:当你的节点数量从 3 台增长到 30 台,手动 SSH 到每一台服务器上安装和配置后端的方式就不再可行。自动化部署不仅节省时间,更保证了一致性和快速恢复能力。本文从最简单的 Shell 脚本开始,逐步介绍 Docker、Ansible 和 cloud-init 等自动化方案,帮助你构建可维护的节点管理体系。

为什么需要自动化部署

手动部署的致命缺陷

在只有两三个节点的时候,手动部署看似可以接受:SSH 登录服务器,执行一系列命令安装后端,编辑配置文件,然后启动服务。但随着节点数量增长,手动部署的问题会迅速暴露。

一致性无法保证。当你手动操作 20 台服务器时,几乎不可能确保每一台的配置完全相同。一个遗漏的参数、一个版本差异,都可能导致特定节点行为异常。更糟糕的是,这些细微差异往往在出问题时才被发现,排查起来极其耗时。

恢复速度慢。节点被封是常态——IP 被 GFW 封锁后,你需要更换 IP 并重新部署服务。如果每次恢复都需要手动操作 30 分钟到一个小时,那么在大规模封锁期间,你的服务恢复速度将严重滞后。

人为错误风险高。重复性操作是人为错误的温床。在深夜维护时打错一个配置参数,可能导致整批节点无法使用,甚至暴露安全隐患。

扩展困难。手动部署意味着每增加一台节点,就需要投入相同的时间成本。这使得快速扩容变得不现实——比如在特殊时期需要临时增加 50 个节点来分散风险时。

自动化部署的核心价值

自动化部署解决的不只是”省时间”的问题,它带来的核心价值包括:

- 可重复性:同一套脚本或配置,无论执行多少次、在多少台机器上执行,结果完全一致

- 速度:批量部署 50 台节点的时间可以从一整天缩短到几分钟

- 可审计性:所有配置变更都有记录,出问题时能快速定位原因

- 快速恢复:节点被封后,更换 IP 再运行一次部署脚本即可,恢复时间从小时级缩短到分钟级

方案一:Shell 脚本(最简单的起步)

Shell 脚本是自动化部署的最低门槛方案。它不需要额外学习任何工具,只需要把手动操作的命令串成一个脚本。

基本思路

将部署步骤编写为一个 Bash 脚本,然后通过 SSH 在远程服务器上执行。核心流程是:准备一个服务器 IP 列表,用循环逐一连接并执行部署脚本。

实践示例:一键部署 Xray + XrayR

以下是一个在全新 Debian/Ubuntu 服务器上部署 Xray 和 XrayR 后端的脚本框架:

1 |

|

批量执行

配合一个 IP 列表文件,用简单的循环批量部署:

1 |

|

其中 servers.txt 的格式为:

1 | 1.2.3.4,1 |

Shell 脚本方案的优缺点

优点:零学习成本,Linux 运维人员都能读懂和修改。

缺点:没有幂等性保证(重复执行可能出错);错误处理粗糙;不适合复杂的多环境配置管理;随着逻辑增多,脚本变得难以维护。

方案二:Docker(容器化部署)

Docker 将应用及其依赖打包成容器镜像,确保在任何服务器上运行的结果完全一致。对于代理后端部署来说,Docker 的价值在于:环境隔离、版本管理清晰、更新回滚方便。

使用 Docker Compose 部署后端

Docker 容器化部署的核心是编写 docker-compose.yml 文件。以下是一个 V2bX 后端的 Docker Compose 示例:

1 | version: '3.8' |

更新流程

使用 Docker 后,节点更新变得极其简单:

1 | # 拉取最新镜像 |

Docker 方案的优缺点

优点:环境隔离彻底,不同后端互不干扰;版本管理清晰,镜像 tag 就是版本号;更新和回滚操作简洁;跨操作系统一致性好。

缺点:需要先在每台服务器上安装 Docker(额外一步);对网络模式有要求(代理后端通常需要 network_mode: host);调试时需要了解 Docker 的日志查看和进入容器的方法。

方案三:Ansible(基础设施即代码)

当节点规模达到几十台以上,Ansible 成为最推荐的自动化方案。Ansible 是一个无代理(agentless)的 IT 自动化工具——它通过 SSH 连接到远程服务器执行操作,不需要在目标服务器上预装任何软件。

核心概念

- Inventory(清单):定义你的所有服务器及其分组

- Playbook(剧本):用 YAML 描述要在服务器上执行的操作步骤

- Role(角色):可复用的任务集合,比如”安装 Docker”、”部署 XrayR”各是一个角色

- Handler(处理器):当配置变更时自动触发的动作,比如重启服务

Playbook 示例

1 | # deploy_node.yml |

Inventory 文件

1 | # inventory.ini |

Ansible 方案的优缺点

优点:幂等性(重复执行不会产生副作用);声明式配置,可读性高;支持变量、模板、条件判断等复杂逻辑;天然适合批量操作;版本控制友好(所有配置都是文本文件)。

缺点:有学习曲线,需要理解 Ansible 的概念模型;对于只有几台节点的小规模场景可能显得过于复杂。

方案四:Cloud-Init / User-Data(创建即就绪)

许多云服务商(如 DigitalOcean、Vultr、AWS 等)支持在创建 VPS 时通过 User-Data 脚本自动执行初始化操作。这意味着 VPS 创建完成时,代理后端已经部署好并运行。

User-Data 脚本示例

1 | #cloud-config |

这种方式特别适合与云服务商的 API 结合使用——通过 API 批量创建 VPS 时附带 User-Data,实现”一键开机即可用”的效果。

监控与运维保障

自动化部署只是第一步。部署完成后,持续的监控同样重要。

存活检测

最基本的监控是检查节点是否在线。可以通过以下几种方式实现:

- TCP 端口检测:定期尝试连接节点的服务端口,确认端口可达

- HTTP 健康检查:如果后端提供了 API 接口,定期调用获取状态

- 外部监控服务:使用 UptimeRobot 等第三方服务从多个地理位置检测节点可达性

流量监控

通过面板(如 V2Board、AirGo 等)自带的流量统计功能,可以观察每个节点的流量趋势。流量突然下降可能意味着节点被封或线路出现问题,应及时排查。

自动告警

将监控与 Telegram Bot 结合,在节点离线或流量异常时自动发送告警通知,能大幅缩短问题发现时间。一个简单的告警脚本可以每分钟检查节点状态,异常时通过 Telegram API 发送消息。

方案选择建议

不同规模的运营场景适合不同的自动化方案:

| 节点规模 | 推荐方案 | 理由 |

|---|---|---|

| 1-5 台 | Shell 脚本 | 简单直接,足够应对 |

| 5-20 台 | Docker + Shell 脚本 | Docker 确保一致性,脚本批量操作 |

| 20-100 台 | Ansible + Docker | 专业的配置管理,可维护性高 |

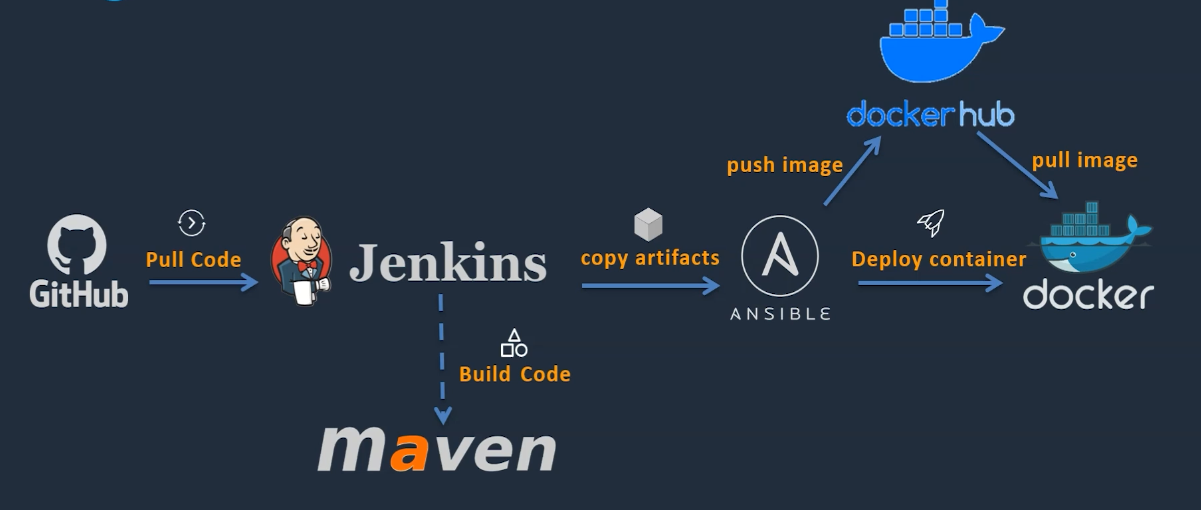

| 100+ 台 | Ansible + Docker + CI/CD | 加入持续集成流水线,全面自动化 |

常见问题(FAQ)

自动化部署是否意味着不需要了解手动部署?

不是。自动化是手动流程的抽象和封装。编写自动化脚本之前,你必须完全理解手动部署的每一步——包括依赖安装、配置文件参数、服务管理方式等。只有在手动部署足够熟练后,才能写出可靠的自动化脚本。

Docker 部署和裸机部署性能有差异吗?

Docker 使用宿主机内核,网络使用 host 模式时几乎没有额外开销。对于代理后端来说,Docker 与裸机部署的性能差异在实际使用中基本不可感知。

Ansible 需要在目标服务器上安装什么?

几乎不需要。Ansible 通过 SSH 连接到目标服务器,唯一的要求是目标服务器上有 Python 环境(大多数 Linux 发行版默认自带)。这也是 Ansible 被称为”无代理”(agentless)工具的原因。

多个方案可以组合使用吗?

可以,而且推荐组合使用。典型的组合是:用 Ansible 管理服务器的基础环境和 Docker 安装,用 Docker Compose 管理后端应用的容器化部署。Ansible 负责”把服务器准备好”,Docker 负责”把应用跑起来”。

自动化部署如何处理不同云服务商的差异?

Ansible 的 Inventory 文件可以按云服务商分组,不同组使用不同的变量。例如,某些云服务商的 VPS 默认使用 Ubuntu,另一些使用 Debian,可以通过条件判断适配。

部署脚本中如何安全管理密钥和密码?

不要将 API Key、面板密码等敏感信息硬编码在脚本中。推荐做法是:使用环境变量传递敏感信息;或使用 Ansible Vault 加密存储;或使用独立的密钥管理服务。